Si ya tienes clara la RAM que necesita tu sistema (como vimos en la entrada anterior), el siguiente paso es elegir el motor que moverá los modelos: la GPU. En 2026, la tarjeta gráfica ha dejado de ser un componente para jugar y se ha convertido en el procesador principal de nuestra «oficina inteligente».

Sin embargo, comprar una GPU para IA no es igual que comprar una para diseño o gaming. Aquí te explicamos en qué debes fijarte para no malgastar tu presupuesto.

1. El factor decisivo: La cantidad de VRAM

En IA, la regla es simple: Si el modelo no cabe en la VRAM, no corre (o corre extremadamente lento).

Cuando usas Ollama o herramientas de generación de imágenes como Stable Diffusion, el modelo completo debe cargarse en la memoria de la tarjeta de video.

-

Si tienes una tarjeta muy potente (mucha velocidad) pero con poca VRAM (ej. 8GB), estarás limitado a modelos pequeños.

-

Si tienes una tarjeta más lenta pero con mucha VRAM (ej. 16GB o 24GB), podrás correr modelos mucho más inteligentes y complejos.

Veredicto: Siempre prioriza la capacidad (GB) sobre la velocidad de reloj para tareas de IA.

2. NVIDIA vs. El Resto: ¿Por qué CUDA sigue mandando?

Aunque AMD e Intel han mejorado mucho, NVIDIA sigue siendo el estándar de oro para IA debido a una tecnología llamada CUDA.

-

CUDA Cores: Son los núcleos que ejecutan los cálculos matemáticos de la IA. Casi todo el software de IA (Ollama, PyTorch, TensorFlow) está optimizado nativamente para NVIDIA.

-

Tensor Cores: Son núcleos especializados exclusivamente en operaciones de matrices (lo que hace la IA). Cuanto más moderna sea la arquitectura (RTX serie 30 o 40), más eficientes son estos núcleos.

3. Las mejores opciones de GPU en 2026

Gama de Entrada (Productividad básica)

-

NVIDIA RTX 3060 (12GB): Sigue siendo la reina de la calidad-precio. Esos 12GB de VRAM permiten correr modelos de 7B y 8B parámetros con mucha soltura.

-

RTX 4060 Ti (16GB): Una opción excelente si buscas eficiencia energética y un extra de memoria para modelos de visión por computadora.

Gama Alta (El estándar profesional)

-

NVIDIA RTX 3090 / 4090 (24GB): El «Santo Grial» para servidores domésticos. Sus 24GB de VRAM son el requisito mínimo para correr modelos de tamaño medio (30B parámetros) o realizar Fine-tuning (entrenar a la IA con tus propios datos).

El camino alternativo: Mac Studio / Mac Mini

Como mencionamos, si no quieres montar un PC por piezas, un Mac con 32GB o 64GB de Memoria Unificada actúa como una GPU gigante. Es la forma más sencilla de tener mucha «VRAM» sin lidiar con cables y fuentes de alimentación enormes.

4. Consumo Energético y Calor

Correr una IA local consume mucha energía. Una RTX 4090 puede consumir más de 400W por sí sola.

-

Optimización Hardware: Asegúrate de tener una fuente de alimentación (PSU) de alta calidad (80+ Gold) y una caja con excelente flujo de aire, ya que la GPU estará trabajando al 100% durante los procesos de inferencia largos.

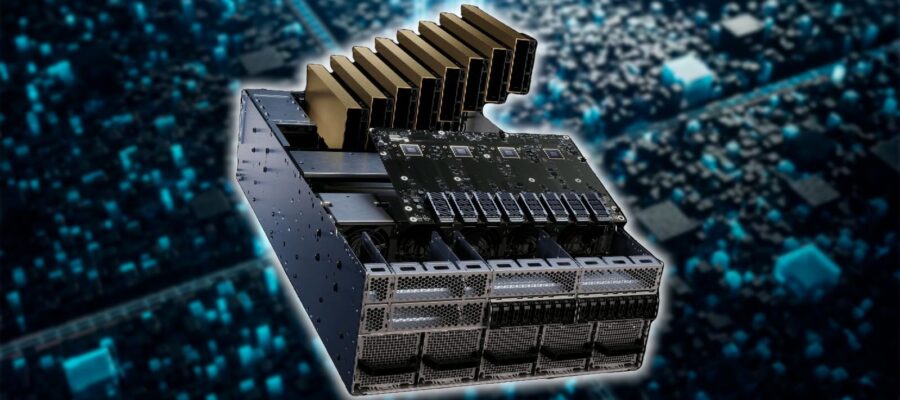

5. ¿Se pueden usar varias GPUs?

Sí, Ollama y otros motores permiten el Multi-GPU. Puedes tener dos tarjetas (ej. dos RTX 3060 de 12GB) y el sistema las sumará para darte 24GB de VRAM totales. Es una forma excelente de reciclar hardware antiguo para potenciar tu servidor de IA.

Conclusión

Para montar un servidor de IA local eficiente, busca el máximo de VRAM que tu bolsillo permita. Una tarjeta con 12GB es el punto de partida, pero si realmente quieres experimentar el poder de los modelos de lenguaje modernos, los 16GB o 24GB marcarán la diferencia entre un asistente que «adivina» y uno que «razona».